Zeitreihenprognosen sind in Organisationen ein operatives Steuerungsinstrument. Forecasts werden regelmäßig aktualisiert, diskutiert und in Entscheidungen übersetzt. Genau deshalb entsteht ein wiederkehrendes Akzeptanzproblem: Prognosen werden als Black Box wahrgenommen.

Business-Anwender erwarten Plausibilität und Vertrauen. Sie müssen einen Forecast verstehen und gegenüber anderen erklären können. Zentral sind dabei zwei Fragen: Welche Treiber wirken? auf den Forecast und woher kommt eine Veränderung?, wenn erneut mit neuen Daten vorhergesagt wird (z.B. im Januar und dann im Februar eine Vorhersage für März getroffen wird).

Explainable AI (XAI) adressiert diese Anforderungen, indem sie Prognosewerte nachvollziehbar macht, wodurch sie entstehen, und warum sie sich zwischen zwei Prognoseläufen verändern.

Erklärbare Zeitreihenprognosen sind für Entscheider relevant, weil Forecast-Systeme durch ihre Prognosen Entscheidungen beeinflussen. Wenn Forecasts als Black Box wahrgenommen werden, sinkt Akzeptanz – unabhängig davon, wie gut die Modelle sind.

Ein belastbarer XAI-Ansatz schafft Transparenz in zwei Dimensionen:

Forecast-Revisionen sind in der Praxis unvermeidbar. Sie entstehen typischerweise durch neue Zielwerte, aktualisierte Features oder Modelländerungen (Parameter, Indikatoren, Algorithmus).

Eine zentrale methodische Grundlage hierfür sind SHAP-Werte, die Vorhersagen als additive Beiträge erklären.

Zeitreihenprognosen werden in der Praxis mit unterschiedlichen Modellklassen umgesetzt. Unterschieden wird hier meist in statistische, Machine Learning (ML) und Deep Learning (DL) Verfahren, aber auch in lineare (bspw. VAR) und nicht-lineare Modelle (bspw. XGBoost).

In produktiven Umgebungen werden Forecasts oft automatisiert erzeugt, z. B. via Auto-ML (statistische, ML und DL-Verfahren) und unter Nutzung eines Feature-Pools.

SHAP (SHapley Additive exPlanations) basiert auf Shapley-Werten aus der koalitionstheoretischen Spieltheorie. Merkmalswerte einer Dateninstanz werden als „Spieler“ betrachtet. Die Vorhersage wird als „Auszahlung“ interpretiert, die fair auf die Merkmale verteilt wird.

Die entscheidende Eigenschaft für Forecasting ist die Additivität:

Die Summe der SHAP-Werte einer Vorhersage entspricht der Differenz zwischen der konkreten Vorhersage und der mittleren Vorhersage.

Dadurch lässt sich eine Prognose als Baseline plus Einflussbeiträge darstellen. Das ist die Basis für nachvollziehbare Treiber-Erklärungen.

Zeitreihenprognosen können sehr viele Beiträge erzeugen, insbesondere durch Lag-Strukturen und mehrere externe Indikatoren. Für die Zielgruppe ist daher entscheidend, dass Erklärungen komplexitätsreduziert werden.

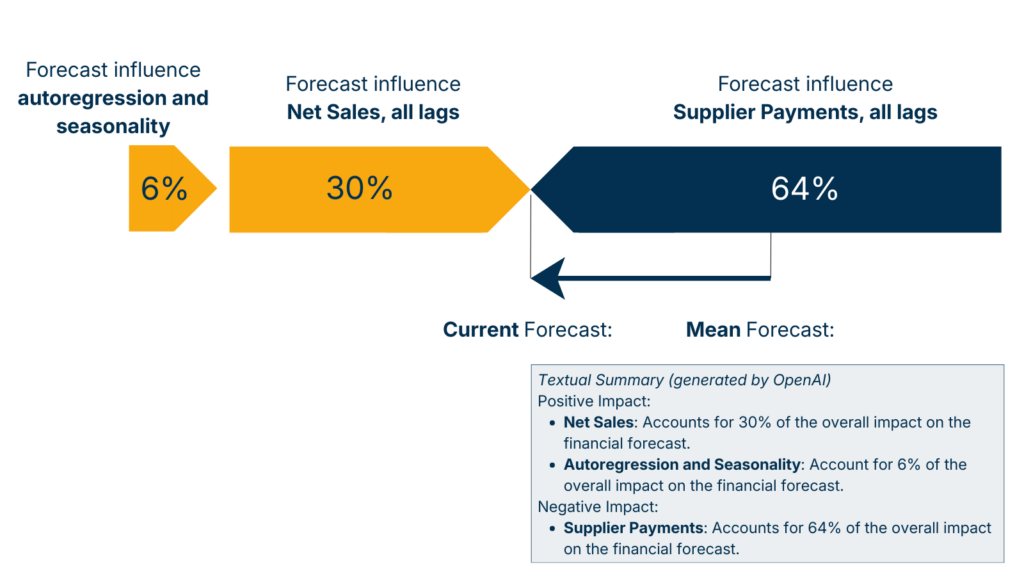

Ein praktikabler Ansatz ist die Aggregation: Autoregression und Saisonalität werden als eigener Einflussblock dargestellt, während Indikatoren über alle Lags hinweg zusammengefasst werden.

Zusätzlich kann eine textuelle Zusammenfassung erzeugt werden, die die wichtigsten positiven und negativen Einflüsse beschreibt.

Für die Praxis ist dabei zentral: Für manche Business-Anwender sind textuelle Erklärungen wichtig, und Komplexitätsreduzierung ist essenziell.

SHAP-based decomposition of a time series forecast showing the contribution of Net Sales (target variable), Supplier Payments (exogenous feature) and autoregressive seasonal effects.

Forecast-Revisionen sind der häufigste Punkt, an dem Vertrauen gewonnen oder verloren wird: Warum weicht eine Prognose zwischen zwei Zeitpunkten ab, obwohl es um denselben Monat geht?

Zwei typische Fragestellungen sind:

Der methodische Kern ist klar:

Forecast-Differenzen werden erklärt, indem die SHAP-Werte der Vorhersagen subtrahiert werden.

Damit wird sichtbar, welche Einflussgrößen und welche Änderungen die Revision treiben.

Forecasts können sich zwischen zwei Läufen aus klar benennbaren Gründen unterscheiden:

Diese Ursachenlogik ist entscheidend, weil sie Diskussionen strukturiert: Eine Revision ist nicht „unerklärlich“, sondern lässt sich auf konkrete Änderungen zurückführen.

Erklärbarkeit ist nur dann wirksam, wenn sie im Betrieb anschlussfähig bleibt.

Praxisrelevante Punkte sind:

Explainable AI im Zeitreihen-Forecasting ist methodisch klar beschreibbar. In der praktischen Umsetzung zeigen sich jedoch strukturelle Hürden.

Für SHAP-Werte existieren Standardbibliotheken. Diese sind jedoch in ihrer Grundform nicht speziell für Zeitreihenmodelle ausgelegt.

Zeitreihenmodelle enthalten:

Eine direkte Anwendung von Standard-SHAP-Implementierungen führt daher häufig zu Erklärungen, die mathematisch korrekt, aber für Zeitreihenstrukturen nicht sinnvoll aggregiert sind.

Erklärbare Zeitreihenprognosen erfordern deshalb eine Anpassung der Darstellung und Aggregation – insbesondere bei Lag-basierten Effekten.

In der Praxis zeigt sich:

Wenn Explainable AI erst nachträglich in bestehende Forecast-Systeme integriert wird, ist der Implementierungsaufwand erheblich.

SHAP-Berechnungen müssen:

Die Erfahrung zeigt, dass eine frühzeitige Berücksichtigung von Erklärbarkeit in der Systemarchitektur deutlich einfacher ist als eine spätere Integration.

Erklärbarkeit ist kein rein technisches Problem.

Selbst wenn SHAP-Werte korrekt berechnet werden, bedeutet das nicht automatisch, dass die Erklärungen akzeptiert oder verstanden werden.

In der Praxis ist eine enge Zusammenarbeit mit Business-Anwendern notwendig, um:

Erst wenn Erklärungen den tatsächlichen Informationsbedarf der Zielgruppe treffen, werden sie genutzt.

Forecast-Systeme werden nicht nur daran gemessen, ob sie Prognosewerte liefern. Sie werden daran gemessen, ob diese Werte verstanden und genutzt werden.

SHAP liefert eine methodische Grundlage, um Forecast-Treiber als additive Beiträge zu erklären. Der entscheidende Mehrwert entsteht jedoch bei Revisionen:

Forecast-Revisionen werden erklärbar, indem SHAP-Werte zweier Vorhersagen differenziert werden.

Die zentrale These lautet:

Ein Forecast-System wird nicht durch komplexere Modelle vertrauenswürdig, sondern durch erklärbare Revisionen.

Erklärbare Zeitreihenprognosen liefern neben einem Forecast-Wert nachvollziehbare Treiber, die erklären, was eine Vorhersage beeinflusst und welche Faktoren eine Änderung zwischen zwei Läufen verursacht.

SHAP-Werte basieren auf Shapley-Werten aus der Spieltheorie und verteilen die Vorhersage fair auf die zugrundeliegenden Einflussfaktoren in einem additiven Erklärungsmodell.

Die Summe der SHAP-Werte entspricht der Differenz zwischen der zeitaktuellen Vorhersage und einer mittleren Vorhersage. So lässt sich ein Forecast als Baseline plus Einflussbeiträge darstellen.

Indem die SHAP-Werte der beiden Vorhersagen voneinander subtrahiert werden.

Typische Ursachen sind neue Target-Werte, neue oder aktualisierte Indikatorwerte sowie Modelländerungen (Parameter, Indikatoren, Algorithmus).

Komplexitätsreduzierung ist essenziell, damit Erklärungen für Business-Anwender nutzbar bleiben.

Für manche Business-Anwender sind textuelle Erklärungen wichtig, um Forecasts intern erklären zu können.